Zusammenfassung – General Purpose AI (GPAI) bringt unter dem EU AI Act neue Governance‑Anforderungen mit sich, die weit über reine Dokumentationspflichten hinausgehen. Für Unternehmen in Deutschland und im DACH‑Raum erfordert die Einhaltung dieser Anforderungen eine kontinuierliche, systemweite Governance, die bis in den produktiven Betrieb reicht und so vertrauenswürdige, skalierbare KI auf Unternehmensebene ermöglicht.

General Purpose AI entwickelt sich rasant zur Grundlage unternehmerischer Innovation. Von Large Language Models bis hin zu multimodalen Systemen, die tief in Geschäftsprozesse integriert sind, ist GPAI längst nicht mehr experimentell – sondern produktiv im Einsatz.

Mit dem Inkrafttreten des EU AI Act (EU‑KI‑Verordnung) stehen Unternehmen in der DACH‑Region vor einer neuen Realität:

General Purpose AI muss als unternehmensweite Fähigkeit gesteuert werden – nicht als einmalige Compliance‑Maßnahme.

Dieser Beitrag erläutert, welche GPAI Pflichten sich aus dem EU AI Act ergeben, warum klassische Governance‑Ansätze nicht ausreichen und wie Unternehmen KI‑Governance operationalisieren können, um Wert zu skalieren und regulatorische Erwartungen zu erfüllen.

Was ist General Purpose AI (GPAI) im Sinne des EU AI Act?

Der EU AI Act definiert General Purpose AI (GPAI) als KI‑Modelle, die für eine Vielzahl von Aufgaben ausgelegt sind und in zahlreiche nachgelagerte Anwendungen integriert werden können – unabhängig davon, wie oder wo sie eingesetzt werden.

Typische Beispiele sind:

- Large Language Models (LLMs)

- Foundation Models, die in mehreren Geschäftsbereichen genutzt werden

- Generative‑AI‑Systeme, die in Unternehmensplattformen eingebettet sind

Im Gegensatz zu spezialisierten KI‑Systemen erzeugt GPAI horizontale Risiken. Ein einziges Modell kann Dutzende von Anwendungsfällen in Marketing, Betrieb, Kundenservice, Analytics und Entscheidungsfindung unterstützen.

Gerade diese breite Einsetzbarkeit ist der Grund, warum der EU AI Act spezifische Pflichten für GPAI‑Anbieter und nachgelagerte Organisationen vorsieht.

GPAI‑Compliance: Welche Pflichten Unternehmen erfüllen müssen

Mit Kapitel V des EU AI Act gelten die GPAI‑Pflichten seit dem 2. August 2025. Sie betreffen Unternehmen in der gesamten EU – einschließlich Organisationen in Deutschland, Österreich und der Schweiz, sofern sie im EU‑Markt tätig sind.

Zentrale GPAI Pflichten

Für alle Anbieter von General Purpose AI‑Modellen schreibt der EU AI Act vor:

Umfassende technische Dokumentation. Aktuelle und nachvollziehbare Dokumentation zu Training, Tests, Fähigkeiten und Grenzen des Modells.

Transparenz für nachgelagerte Nutzung. Die Dokumentation muss Unternehmen, die GPAI in ihre Systeme integrieren, in die Lage versetzen, Risiken zu verstehen und eigene Pflichten zu erfüllen.

Urheberrechts‑ und Copyright‑Richtlinien. Anbieter müssen Richtlinien implementieren, die das EU‑Urheberrecht und Rechte an Trainingsdaten berücksichtigen.

Öffentliche Zusammenfassung der Trainingsdaten

Eine standardisierte, öffentlich zugängliche Beschreibung der für das Training verwendeten Daten.

Zusätzliche Pflichten für GPAI mit systemischem Risiko

Für besonders leistungsfähige Modelle gelten weitergehende Anforderungen, unter anderem:

- Risikoanalyse und Risikominderung

- Meldung schwerwiegender Vorfälle

- Cybersicherheitsmaßnahmen

- Zusammenarbeit mit dem EU AI Office

Zur Unterstützung der Umsetzung hat die Europäische Kommission einen freiwilligen GPAI Code of Practice veröffentlicht. Dieser deckt Transparenz, Urheberrecht sowie Sicherheit und Schutzmaßnahmen ab und bietet einen anerkannten Weg, Compliance nachzuweisen.

Warum GPAI‑Compliance eine organisatorische Herausforderung ist – keine rein rechtliche

Viele Unternehmen betrachten GPAI‑Compliance primär als Dokumentations‑ oder Rechtsaufgabe. Dieses Verständnis greift zu kurz.

GPAI‑Modelle:

- werden von zahlreichen Teams wiederverwendet

- treiben mehrere KI‑Systeme parallel an

- lernen weiter, verändern sich und erzeugen Outputs auch nach dem Go‑Live

Hier entsteht eine kritische Lücke.

Die meisten KI‑Governance‑Ansätze enden bei der Modellfreigabe – lange bevor Risiken und Wertschöpfung im Produktivbetrieb entstehen.

Für DACH‑Unternehmen, die KI skalieren wollen, liegt die Herausforderung nicht im Verständnis der Regulierung, sondern in der Operationalisierung von Governance über den gesamten KI‑Lebenszyklus hinweg – von Design über Deployment bis zur Laufzeit.

Der Wandel hin zu kontinuierlicher KI‑Governance

Um KI verantwortungsvoll und wirtschaftlich zu skalieren, benötigen Unternehmen Governance, die:

- kontinuierlich statt punktuell ist

- in die Ausführung eingebettet ist, statt manuell gesteuert zu werden

- Daten, Modelle und KI‑Systeme zusammenführt

- auf Wiederverwendung statt Wiederholung ausgelegt ist

Gerade bei General Purpose AI ist dies entscheidend:

- Ein Modell unterstützt viele Use Cases

- Risiken potenzieren sich in nachgelagerten Systemen

- Wert entsteht durch konsistente Wiederverwendung und Vertrauen

Kontinuierliche Governance ermöglicht:

- Governance von GPAI‑Systemen im Produktivbetrieb

- Durchsetzung von Richtlinien zur Laufzeit

- Monitoring von Modellverhalten und Drift

- Governance für autonome und agentenbasierte KI‑Systeme

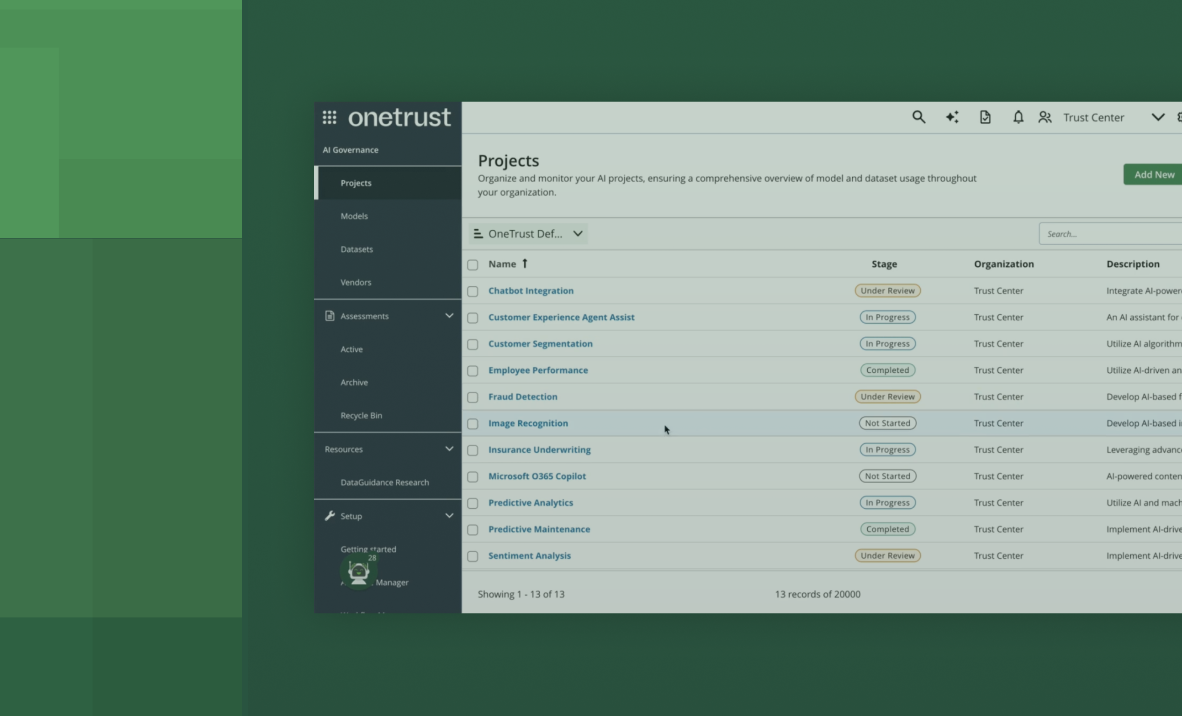

GPAI‑Governance operationalisieren mit OneTrust

GPAI zu skalieren und gleichzeitig die Pflichten des EU AI Act zu erfüllen, erfordert mehr als Richtlinien und Checklisten. Es erfordert ein System kontinuierlicher Governance.

OneTrust ist die AI‑Ready Governance Platform™ – das System, mit dem Unternehmen Daten und KI als gesteuerte, wiederverwendbare Unternehmensfähigkeit operationalisieren.

Für GPAI‑ und EU‑AI‑Act‑Readiness ermöglicht OneTrust Unternehmen:

- Verknüpfung von KI‑Inventar, Dokumentation und Risikomanagement über den gesamten KI‑Lebenszyklus

- Operationalisierung der EU‑AI‑Act‑ und GPAI‑Code‑of‑Practice‑Anforderungen

- Governance von KI‑Systemen im Produktivbetrieb, nicht nur in der Designphase

- Durchsetzung von Richtlinien zur Laufzeit bei unternehmensweiter Wiederverwendung von Modellen

- Aufbau vertrauenswürdiger, wiederverwendbarer Daten‑ und KI‑Assets mit wachsendem Mehrwert

- Governance wird damit nicht zum Innovationshemmnis, sondern zum Mechanismus, mit dem KI sicher, konsistent und mit messbarem ROI skaliert werden kann.

Was DACH‑Unternehmen jetzt tun sollten

Für Unternehmen in Deutschland, Österreich und der Schweiz markiert der EU AI Act einen strategischen Wendepunkt.

Führende Organisationen:

- erfassen den Einsatz von General Purpose AI unternehmensweit

- richten KI‑Governance auf kontinuierliche, systemweite Ausführung aus

- bereiten sich auf Governance im Produktivbetrieb und für agentenbasierte KI vor

- verstehen Governance als strategischen Enabler – nicht als regulatorische Last

GPAI‑Compliance bedeutet nicht mehr Bürokratie.

Sie bedeutet, KI so aufzubauen, dass sie vertrauenswürdig, wiederverwendbar und skalierbar ist.

Nächster Schritt

Erfahren Sie, wie Unternehmen EU‑AI‑Act‑ und GPAI‑Governance auf Enterprise‑Ebene operationalisieren – mit der OneTrust AI Governance Lösung.

Besuchen Sie die AI‑Governance‑Lösungsseite, um zu sehen, wie kontinuierliche Governance vertrauenswürdige und skalierbare General Purpose AI im gesamten Unternehmen ermöglicht.