Sintesi

La classificazione dei sistemi di intelligenza artificiale come High‑Risk ai sensi del EU AI Act cambia radicalmente il modo in cui le organizzazioni devono progettare, governare e operare l’IA. Non si tratta di un requisito documentale isolato, ma di un insieme di obblighi continui che incidono direttamente su processi, ruoli, responsabilità e operatività in produzione. Per le organizzazioni che sviluppano o utilizzano sistemi di IA ad alto rischio, la compliance diventa una decisione di modello operativo.

Le imprese stanno integrando l’IA sempre più profondamente in processi critici come selezione del personale, credito, sanità, sicurezza, servizi pubblici e decisioni automatizzate. Tuttavia, quando questi sistemi rientrano nella categoria High‑Risk, la tolleranza all’improvvisazione si azzera. Il valore dell’IA può scalare solo se la governance scala con essa.

Cosa significa “High‑Risk” nel EU AI Act

Il EU AI Act classifica come High‑Risk i sistemi di IA che incidono su diritti fondamentali, sicurezza o accesso a servizi essenziali. Non conta solo la tecnologia utilizzata, ma il contesto d’uso e l’impatto del sistema. Un modello può diventare High‑Risk quando viene integrato in processi decisionali regolamentati o ad alto impatto.

Questa classificazione attiva un set di obblighi specifici che si applicano lungo tutto il ciclo di vita del sistema, dalla progettazione all’uso in produzione.

Cosa cambia concretamente per le organizzazioni

Quando un sistema di IA è classificato come High‑Risk, le organizzazioni devono dimostrare controllo continuo, non solo conformità iniziale. In particolare, diventano obbligatori:

- una gestione strutturata dei rischi lungo l’intero ciclo di vita del sistema,

- dati di addestramento adeguati, rappresentativi e monitorati,

- documentazione tecnica aggiornata e tracciabile,

- registrazione delle attività e capacità di audit,

- supervisione umana chiara e operativa,

- monitoraggio del comportamento del sistema in produzione,

- gestione e segnalazione degli incidenti.

La compliance non si esaurisce al momento dell’approvazione del sistema. Deve continuare finché il sistema è in uso.

Perché la compliance High‑Risk è una sfida operativa, non solo legale

Molte organizzazioni affrontano la classificazione High‑Risk come un problema di interpretazione normativa. In realtà, la difficoltà principale emerge dopo il go‑live. I sistemi evolvono, vengono riaddestrati, riutilizzati in nuovi contesti e integrati in processi diversi.

Senza una governance operativa, i controlli si fermano troppo presto. La documentazione diventa obsoleta, la supervisione umana perde efficacia e il rischio aumenta proprio dove il valore dovrebbe crescere. La classificazione High‑Risk rende evidente una verità spesso ignorata: la governance dell’IA deve funzionare anche in produzione.

Un modello operativo per gestire sistemi High‑Risk

Per gestire la compliance High‑Risk in modo sostenibile, le organizzazioni devono adottare un modello operativo che integri governance, rischio e operatività. Questo significa definire ruoli chiari, responsabilità esplicite e processi ripetibili che collegano policy, sistemi e persone.

La governance deve essere continua, basata su evidenze e capace di adattarsi quando i sistemi cambiano. Solo così la compliance smette di essere un freno e diventa un abilitatore della scalabilità.

Le evidenze richieste: cosa significa “essere compliant”

Il EU AI Act non richiede solo dichiarazioni di conformità, ma la capacità di dimostrare, in ogni momento, che i requisiti sono rispettati. Le organizzazioni devono poter produrre evidenze che mostrino come i rischi vengono gestiti, come la supervisione è esercitata e come gli incidenti vengono rilevati e affrontati.

La domanda chiave è sempre la stessa: possiamo dimostrare, oggi, che questo sistema di IA è sotto controllo?

Dalla compliance statica alla governance continua

I sistemi High‑Risk non possono essere governati con controlli una tantum. La governance deve estendersi all’intero ciclo di vita, includendo modifiche, riutilizzi, aggiornamenti e comportamento in produzione. È qui che molte organizzazioni incontrano difficoltà, non per mancanza di competenze, ma per assenza di un sistema unificato di governance.

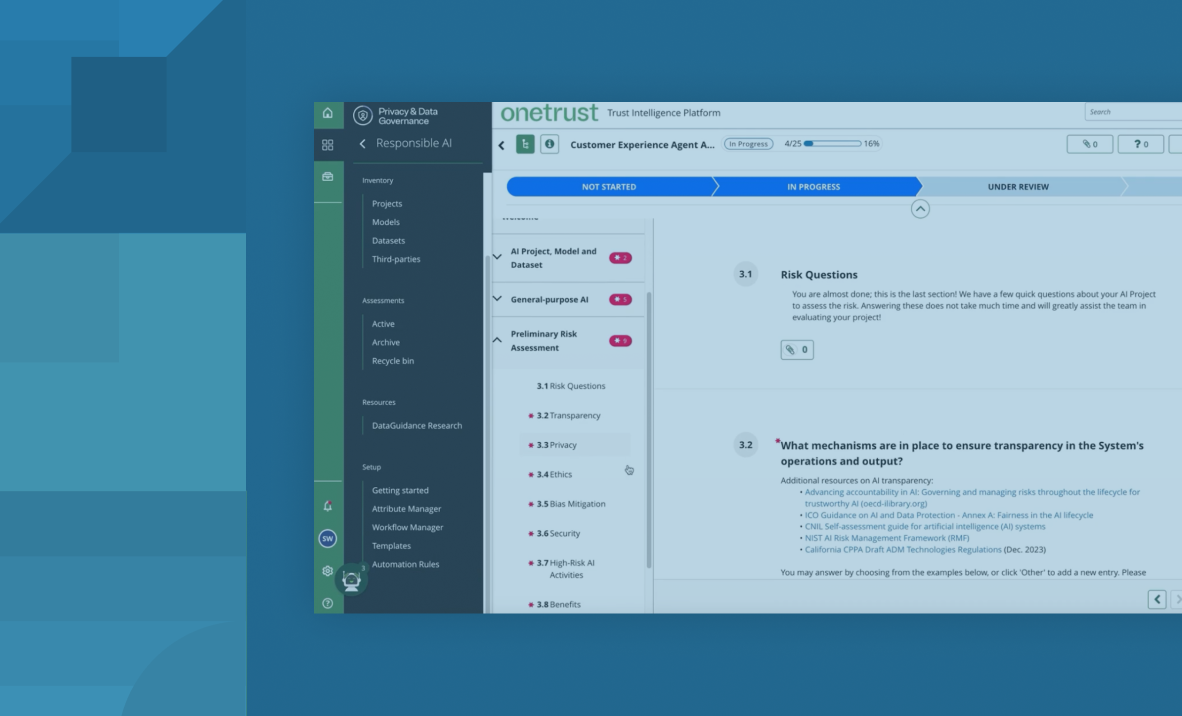

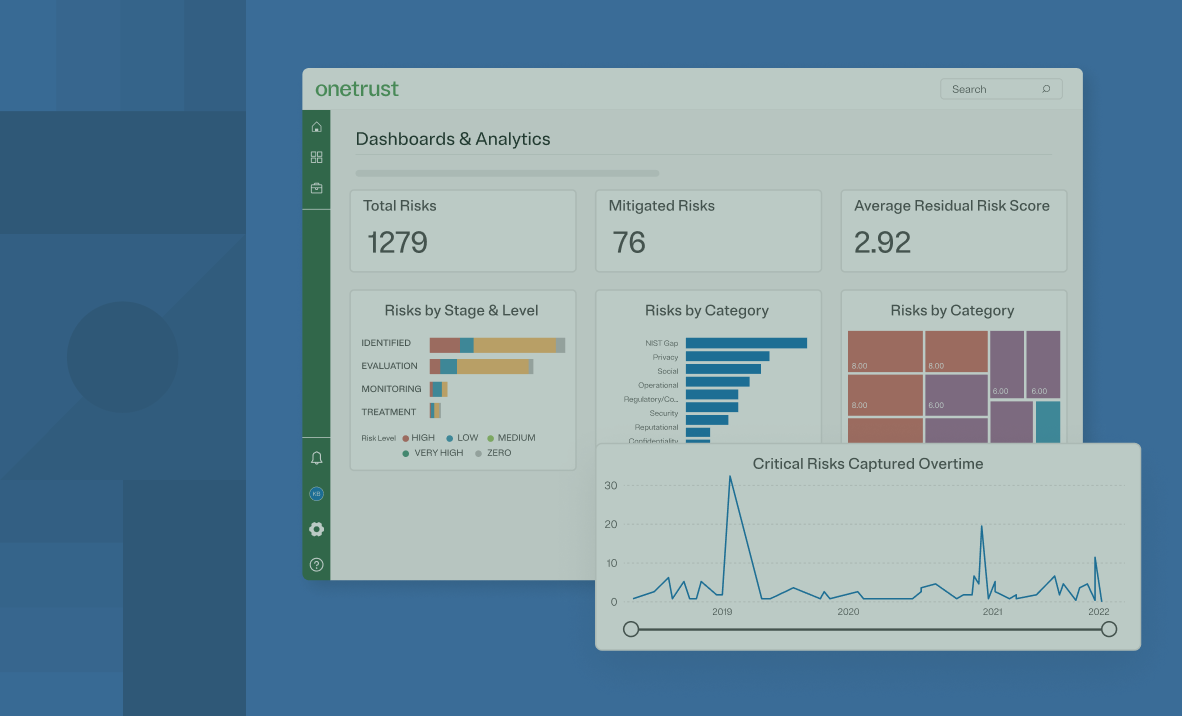

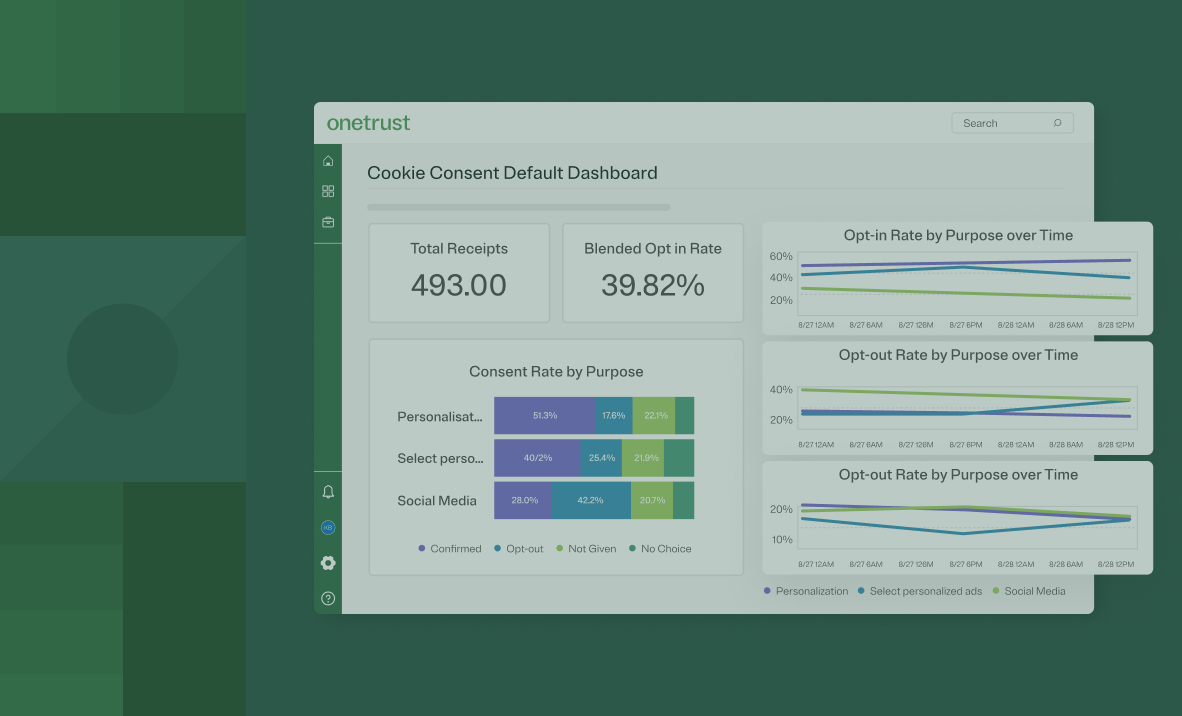

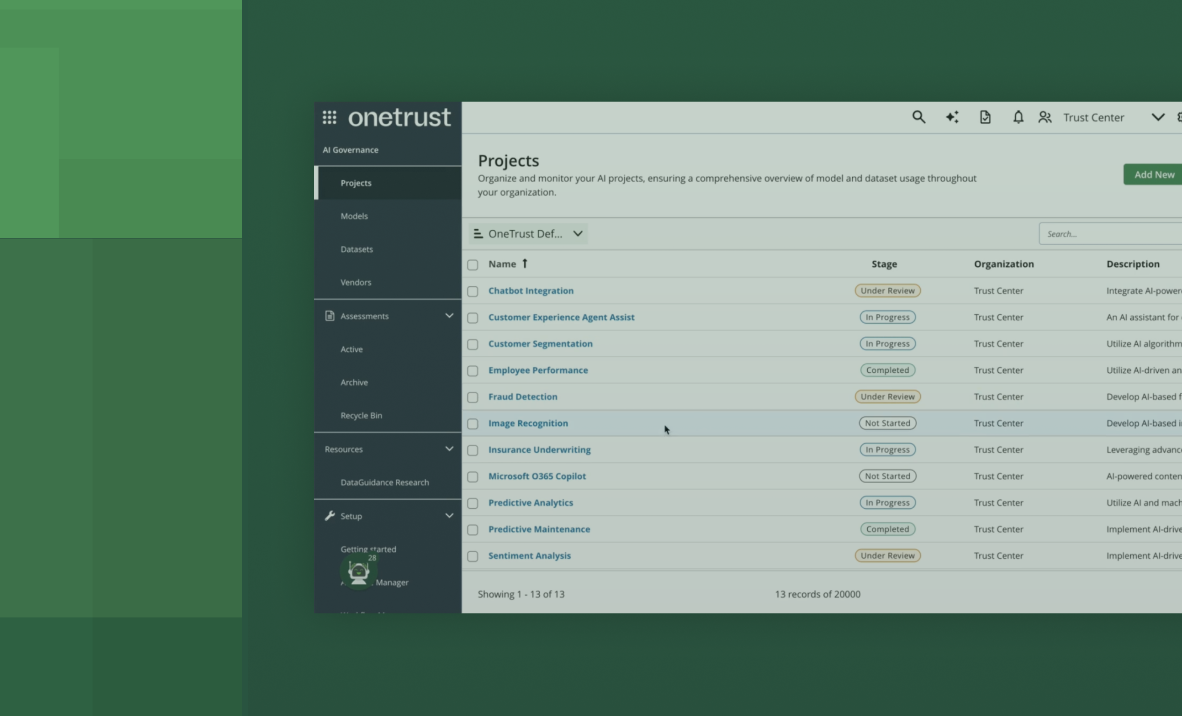

Operativizzare la compliance High‑Risk con OneTrust

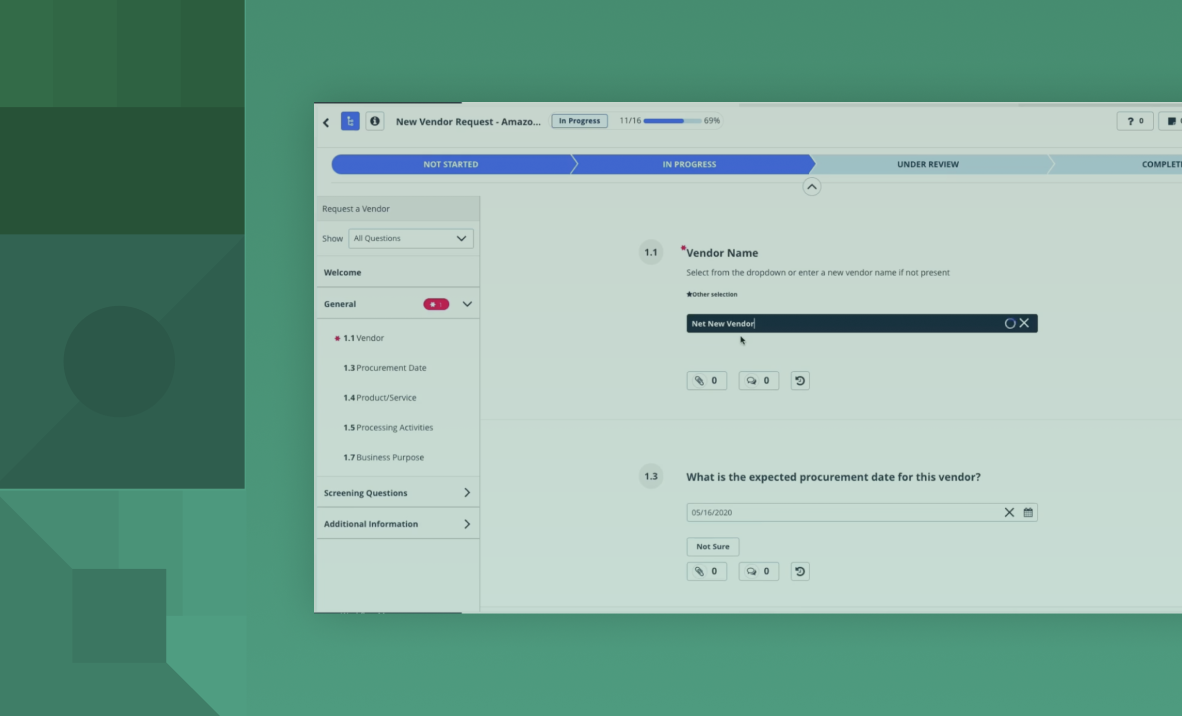

Gestire la compliance High‑Risk richiede più di policy e checklist. OneTrust è la AI‑Ready Governance Platform™ che consente alle organizzazioni di governare l’IA come una capacità enterprise continua e riutilizzabile.

Per i sistemi High‑Risk, OneTrust aiuta a collegare inventario IA, gestione del rischio, documentazione e supervisione in un unico framework operativo, supportando la governance in produzione e l’evoluzione dei sistemi nel tempo. La compliance diventa così parte dell’esecuzione quotidiana, non un’attività isolata.

Cosa dovrebbero fare ora le organizzazioni

Le organizzazioni dovrebbero identificare i sistemi che rientrano nella classificazione High‑Risk, valutare se i controlli attuali funzionano anche in produzione e trasformare la compliance in un processo continuo. Governare l’IA ad alto rischio significa costruire fiducia che può scalare insieme all’innovazione.

Prossimo passo

Per scoprire come le organizzazioni operativizzano la compliance del EU AI Act per i sistemi High‑Risk, esplora la soluzione OneTrust AI Governance e scopri come una governance continua consente di scalare l’IA in modo conforme, affidabile e sostenibile a livello enterprise.